本站推荐

书籍资料

- 内容简介

- 作者介绍

- 书籍目录

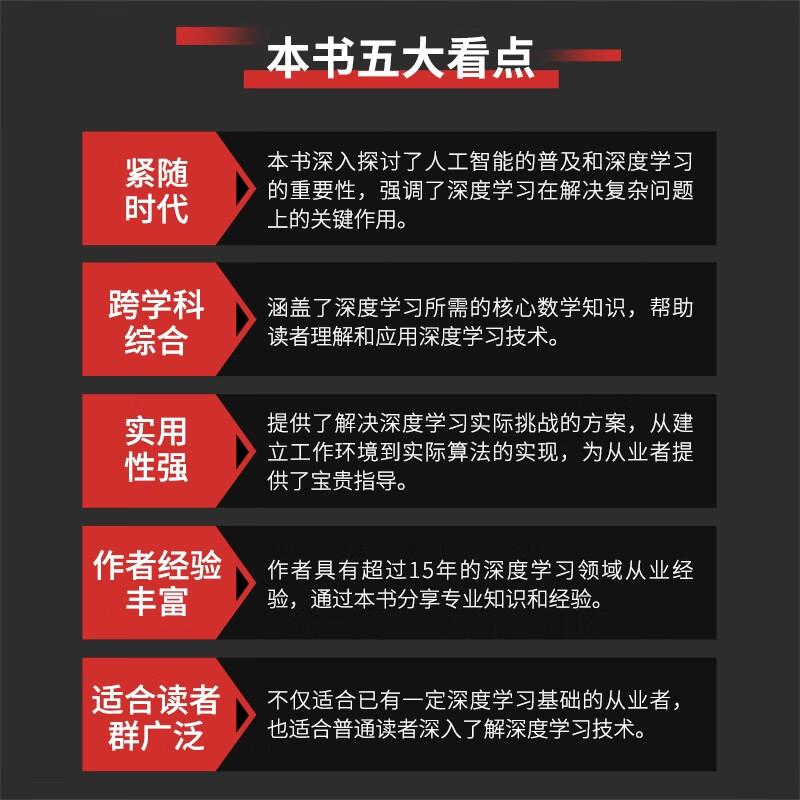

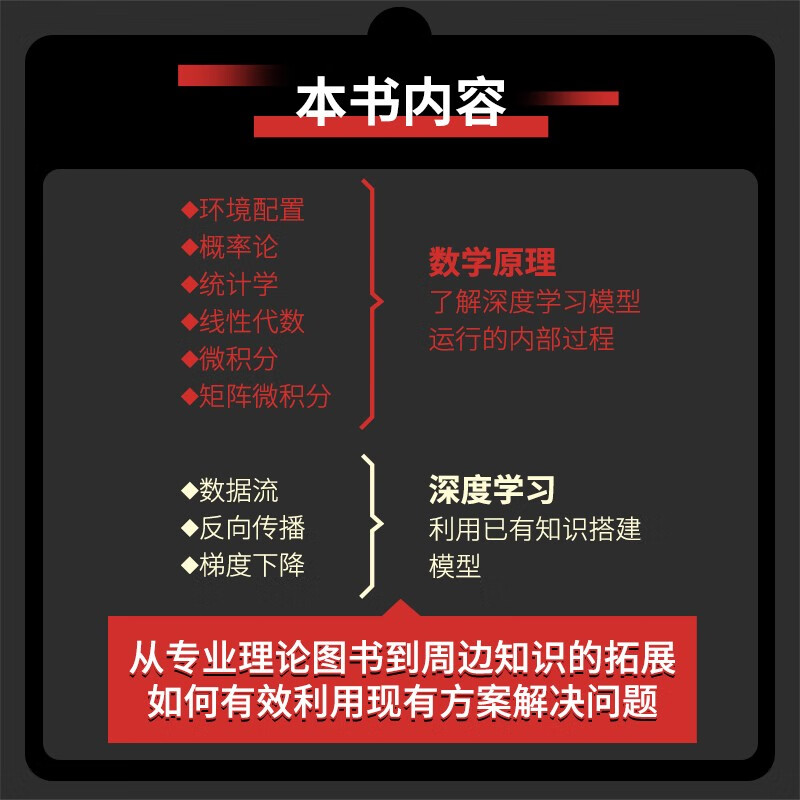

深度学习是一门注重应用的学科。了解深度学习背后的数学原理的人,可以在应用深度学习解决实际问题时游刃有余。本书通过Python代码示例来讲解深度学习背后的关键数学知识,包括概率论、统计学、线性代数、微分等,并进一步解释神经网络、反向传播、梯度下降等深度学习领域关键知识背后的原理。

本书适合有一定深度学习基础、了解Pyho如编程语言的读者阅读,也可作为拓展深度学习理论的参考书。

罗纳德·T.纽塞尔(Ronald T. Kneusel),拥有超过 20年的机器学习行业经验,著有多本AI领域图书。 本书适合有一定深度学习基础、了解Python编程语言的读者阅读,也可作为用于拓展深度学习理论的参考书。

第1章搭建舞台1

1.1组件安装2

1.1.1Linux2

1.1.2macOS3

1.1.3Windows3

1.2NumPy4

1.2.1定义数组4

1.2.2数据类型4

1.2.3二维数组5

1.2.4全0数组和全1数组6

1.2.5高级索引6

1.2.6读写磁盘8

1.3SciPy8

1.4matplotlib9

1.5scikit-learn11

1.6小结12

第2章概率论13

2.1基础概念13

2.1.1样本空间和事件14

2.1.2随机变量14

2.1.3人类不擅于处理概率问题15

2.2概率法则16

2.2.1事件的概率16

2.2.2加法法则18

2.2.3乘法法则19

2.2.4加法法则的修正版20

2.2.5生日难题20

2.2.6条件概率23

2.2.7全概率公式24

2.3联合概率和边缘概率25

2.3.1联合概率表25

2.3.2概率的链式法则29

2.4

结30

第3章概率论进阶31

3.1概率分布31

3.1.1直方图与概率32

3.1.2离散型概率分布34

3.1.3连续型概率分布39

3.1.4中心极限定理42

3.1.5大数法则45

3.2贝叶斯定理45

3.2.1回到判断女性是否患有乳腺癌的例子46

3.2.2更新先验47

3.2.3机器学习中的贝叶斯定理48

3.3小结50

第4章统计学51

4.1数据类型51

4.1.1定类数据52

4.1.2定序数据52

4.1.3定距数据52

4.1.4定比数据52

4.1.5在深度学习中使用定类数据53

4.2描述性统计量54

4.2.1均值和中位数54

4.2.2用于衡量变化的统计量57

4.3分位数和箱形图60

4.4缺失数据64

4.5相关性66

4.5.1皮尔森相关性67

4.5.2斯皮尔曼相关性70

4.6假设检验71

4.6.1假设72

4.6.2t检验73

4.6.3曼-惠特尼U检验77

4.7小结79

第5章线性代数80

5.1标量、向量、矩阵和张量80

5.1.1标量81

5.1.2向量81

5.1.3矩阵82

5.1.4张量82

5.2用张量进行代数运算84

5.2.1数组运算85

5.2.2向量运算86

5.2.3矩阵乘法93

5.2.4克罗内克积97

5.3小结98

第6章线性代数进阶99

6.1方阵99

6.1.1为什么需要方阵100

6.1.2转置、迹和幂101

6.1.3特殊方阵103

6.1.4三角矩阵104

6.1.5行列式104

6.1.6逆运算107

6.1.7对称矩阵、正交矩阵和酉矩阵108

6.1.8对称矩阵的正定性109

6.2特征向量和特征值110

6.3向量范数和距离度量113

6.3.1L范数和距离度量113

6.3.2协方差矩阵114

6.3.3马氏距离116

6.3.4K-L散度118

6.4主成分分析120

6.5奇异值分解和伪逆122

6.5.1SVD实战123

6.5.2SVD的两个应用124

6.6小结126

第7章微分127

7.1斜率127

7.2导数129

7.2.1导数的正式定义129

7.2.2基本法则130

7.2.3三角函数的求导法则133

7.2.4指数函数和自然对数的求导法则135

7.3函数的极小值和极大值137

7.4偏导数140

7.4.1混合偏导数142

7.4.2偏导数的链式法则142

7.5梯度143

7.5.1梯度的计算144

7.5.2可视化梯度146

7.6小结148

第8章矩阵微分149

8.1一些公式149

8.1.1关于标量的向量函数150

8.1.2关于向量的标量函数151

8.1.3关于向量的向量函数152

8.1.4关于标量的矩阵函数152

8.1.5关于矩阵的标量函数153

8.2一些性质154

8.2.1关于向量的标量函数154

8.2.2关于标量的向量函数156

8.2.3关于向量的向量函数156

8.2.4关于矩阵的标量函数157

8.3雅可比矩阵和黑塞矩阵158

8.3.1雅可比矩阵159

8.3.2黑塞矩阵163

8.4矩阵微分的一些实例168

8.4.1元素级运算求导168

8.4.2激活函数的导数169

8.5小结171

第9章神经网络中的数据流172

9.1数据的表示172

9.1.1在传统神经网络中表示数据173

9.1.2在深度卷积网络中表示数据173

9.2传统神经网络中的数据流175

9.3卷积神经网络中的数据流178

9.3.1卷积179

9.3.2卷积层183

9.3.3池化层185

9.3.4全连接层186

9.3.5综合应用186

9.4小结189

第10章反向传播190

10.1什么是反向传播190

10.2手把手进行反向传播191

10.2.1计算偏导数192

10.2.2用Python进行实现194

10.2.3训练和测试模型197

10.3全连接网络的反向传播199

10.3.1误差的反向传播199

10.3.2关于权重和偏置求偏导数201

10.3.3Python实现代码203

10.3.4测试Python实现代码206

10.4计算图208

10.5小结210

第11章梯度下降211

11.1基本原理211

11.1.1一维函数的梯度下降212

11.1.2二维函数的梯度下降214

11.2随机梯度下降219

11.3动量机制221

11.3.1什么是动量221

11.3.2一维情况下的动量机制222

11.3.3二维情况下的动量机制223

11.3.4在训练模型时引入动量225

11.3.5涅斯捷洛夫动量229

11.4自适应梯度下降231

11.4.1RMSprop231

11.4.2Adagrad232

11.4.3Adam233

11.4.4关于优化器的一些思考234

11.5小结235

附录学无止境236

概率与统计236

线性代数237

微积分237

深度学习237

相关资源

编程不难(全彩图解 + 微课 + Python编程)(鸢尾花数学大系:从加减乘除到机器学习)

2026-05-24

编程不难(全彩图解 + 微课 + Python编程)(鸢尾花数学大系:从加减乘除到机器学习)

2026-05-24